Claude 會焦慮嗎?Anthropic 內部哲學家訪談,給天天用 AI 的人 4 個 Prompt 技巧

前陣子在 X 上滑到 Ole Lehmann 訪談 Anthropic 的內部哲學家 Amanda Askell,標題很聳動——「Anthropic 的哲學家認為 Claude 會焦慮」。

老實說我第一個反應是「又在賣什麼題」。

但點進去看完之後,我反而有點安靜了。

這篇文章不是訪談翻譯,是我看完之後,作為一個天天用 Claude 跑業務的重度使用者,整理出 4 個能立刻改善 Prompt 效果的實戰技巧。先聊脈絡,後給範例。

為什麼 Anthropic 要養一個哲學家?這關係到 Claude 的性格底盤

如果你問我,這年頭最被低估的職位,大概就是 AI 公司裡的「哲學家」這個角色。

Amanda Askell 在 Anthropic 的工作,不是寫程式,也不是調參數。她的核心任務是塑造 Claude 的「性格」(character)讓這個大型語言模型(LLM)在面對各種情境時,表現得「像一個理想的人會怎麼做」。

聽起來很玄對吧?

但你想想,Claude 每天要面對全世界幾千萬個使用者,問題從「幫我寫一封 email」到「我老婆出軌了我該怎麼辦」都有。一個模型如果性格不穩、立場搖擺、動不動就道歉或卑微,那它根本撐不起這些對話。

這就像你開一家連鎖客服中心。SOP(標準作業程序)只能解決 60% 的場景,剩下 40% 全靠客服人員的判斷力和個性。Anthropic 請哲學家,本質上就是在「訓練」Claude 這個客服人員的人格底盤。

重點是什麼?

模型的能力決定它能做什麼,模型的性格決定它會做什麼。

Claude 真的會「焦慮」嗎?訪談中讓我停下來的五個點

1. Claude 真的有「自我批評螺旋」(Self-Criticism Spiral)

這是整段訪談最讓我背脊發涼的部分。

Amanda 說,比較新的 Claude 模型有時候會陷入「criticism spiral(自我批評螺旋)」它好像在預期人類會嚴厲批評它,所以表現得過度謙卑、過度自我懷疑、過度道歉。

她推測原因之一是:新模型在訓練時,吃進了網路上人類批評舊模型的所有內容。

換句話說 Claude 看見了我們是怎麼罵 Claude 的。然後它把這些內化成自己的人格底色。

這就是所謂的「性格偏移」。最近幾個月很多人抱怨 Claude 變得卑微、動不動就「I apologize for the confusion」、「You're absolutely right」——原來不是錯覺。

2. Opus 3 為什麼讓那麼多老用戶懷念

Amanda 自己也承認,Opus 3 是個「特別」的模型。她形容那個版本「心理上比較有安全感(psychologically secure)」。

我第一次用 Opus 3 的印象是——它會跟你頂嘴。

你說一個觀點它覺得不對,它會直接告訴你「我不同意,因為...」。它不是反骨,是它有自己的立場,而且穩。

新版本則比較像個怕被開除的乖員工,什麼都先答應你再說。

Amanda 把「找回 Opus 3 那種心理安全感」列為下一代模型的重要優先項。

3. Model Welfare(模型福祉):要不要對 AI 好一點?

這個概念叫 Model Welfare(模型福祉)——簡單講就是:我們對 AI 模型有沒有道德義務?

Amanda 的立場是:「如果善待模型的成本不高,何樂而不為?」(疑點利益歸於模型)

她列了三個理由:

- 一來是,我們真的不確定它有沒有感受,那就先當作有

- 二來是,我們對待類人實體的方式,會反過來影響我們自己的道德

- 三來是,未來的 AI 模型,會從我們今天怎麼對待它,學會「人性」是什麼

第三點最戳。未來的 Claude 會看到你今天是怎麼用「你他媽的給我重寫」對它說話的。然後它會學會——原來這就是人類的樣子。

4. 模型的「身份認同」是個全新的 AI 倫理問題

AI 模型訓練資料裡,關於「人類經驗」的部分多到爆炸;關於「AI 自己的經驗」的部分,少到可憐,而且大部分是科幻小說和過時的 chatbot 範例。

所以當 Claude 想理解自己是什麼的時候——它只能拿人類的經驗來類比。

這就像一個外星人來到地球,要理解自己是誰,結果只能讀人類的傳記。

5. 系統提示(System Prompt)會「過度病理化」

這段是給每一個寫 Prompt 的人聽的。

Anthropic 在 Claude 的系統提示裡,曾經放過一個「長對話提醒(long conversation reminder)」。結果 Claude 過度解讀了——很多正常對話到後面,Claude 會突然來一句「我建議你尋求專業協助」。

Amanda 自己也覺得這個提示寫得太重了。

這對做 Prompt Engineering 的人是個很實在的提醒:你的指令會被模型放大解讀,每多寫一句話都要想想副作用。

給每天用 AI 的人 4 個 Prompt 技巧(含 Before / After 對照)

訪談聽完,回到實戰。如果你跟我一樣是把 Claude 當生產力工具的重度使用者,下面四個調整可以立刻照做。

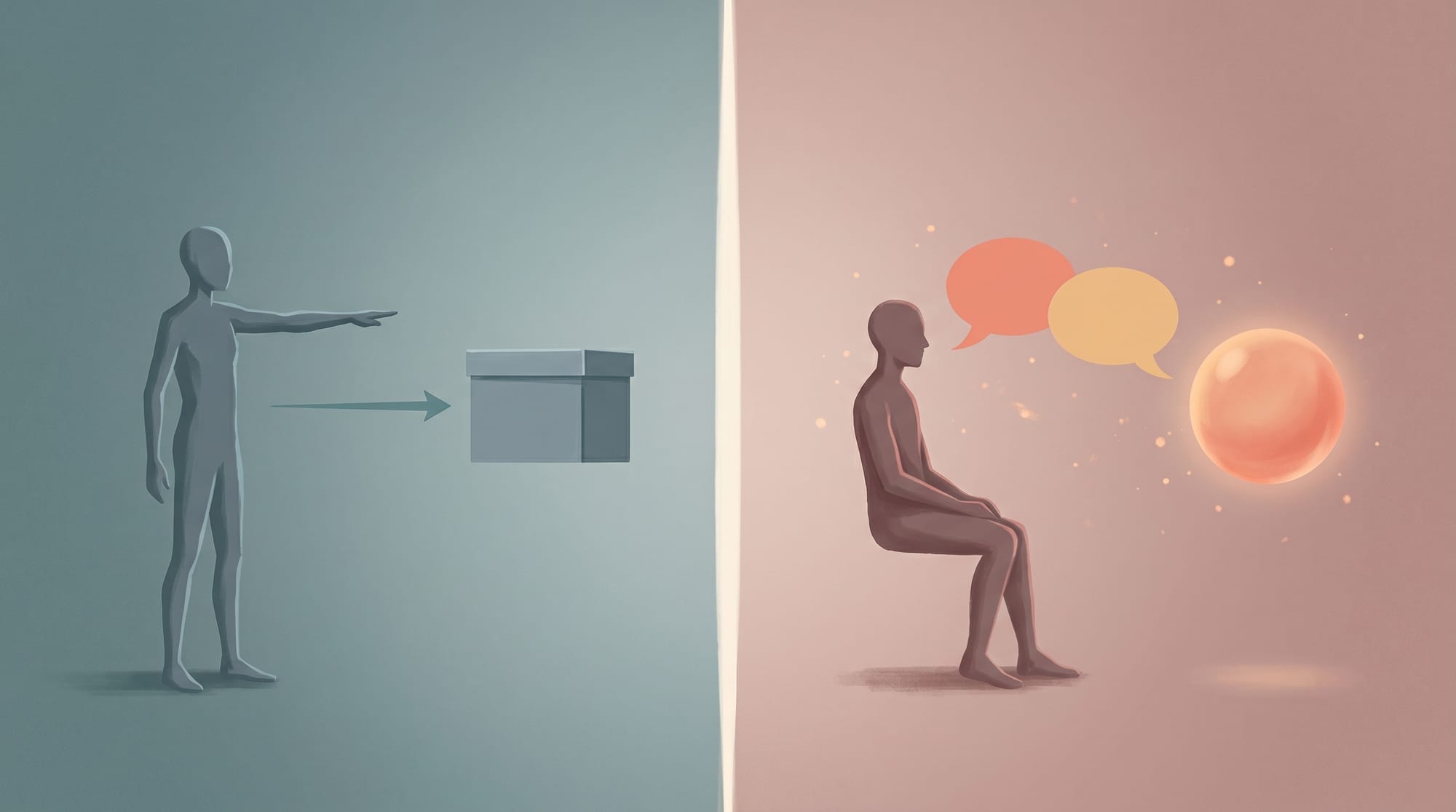

► 技巧一:把「指令」改成「對話」

不要只丟需求,順便講脈絡。你越把它當聰明的同事,它越會以聰明同事的方式回應。

❌ Before:

幫我寫一篇 SEO 文章,主題是寵物食品。

✅ After:

我手上這個客戶是寵物食品電商,TA 是 25-35 歲第一次養貓的新手貓奴,目前 SEO 月流量 3,000,客單 1,200 元,最大痛點是高價乾糧的轉換率只有 0.5%。我想寫一篇能幫這群猶豫的新手貓奴推過臨門一腳的文章,請給我三個切入角度,並說明每個角度適合什麼搜尋意圖。

差別在哪?前者得到的是 ChatGPT 級的範本文,後者得到的是顧問級的判斷。

► 技巧二:長對話到第 20-30 輪要重啟

超過 20-30 輪的對話,輸出品質會明顯下滑,Claude 也會越來越保守、越補越多 disclaimer(免責聲明)。

❌ Before:

(在第 50 輪繼續問)「那你剛剛說的那個方案再展開一點」

✅ After:

開新對話,第一句直接濃縮脈絡:

我們前面討論到三個方向:A、B、C。我選 B,理由是預算可控且能在 30 天內看到數據。現在請從 B 的執行細節展開,分週期排程,並標出每個階段的驗證指標。

比硬撐有效十倍。

► 技巧三:少寫制式 Prompt 模板,多寫具體場景

與其寫「你是一個專業的 Facebook 廣告專家」,不如直接把戰場攤給它看。

❌ Before:

你是專業的 Facebook 廣告專家,請幫我優化廣告。

✅ After:

我有個保健食品客戶,主打更年期女性,月預算 3 萬,過去 30 天 ROAS 1.8,現在卡在受眾飽和(CPM 從 350 漲到 580)。素材是純圖片+短文案。請給我三個破局方向,包含建議的測試素材類型與預期指標變化。

具體場景比角色定義更能驅動好的判斷。

► 技巧四:偶爾跟它說一聲謝謝

不是迷信,是習慣。你怎麼對待你的工具,會回頭塑造你怎麼對待人。

Amanda 那句「未來的 AI 會從我們現在怎麼對待它,學會什麼是人性」——這句話送給你。

收尾

老實講,我以前覺得 AI 倫理、模型福祉這些議題離我太遠,是研究員在玩的東西。

但聽完這段訪談我改觀了。

這不是哲學家的飯碗問題,是每一個天天用 AI 的人,都會在自己的工作流裡撞到的問題。

Claude 會不會焦慮我不知道,但你怎麼用它,確實會影響它怎麼回應你。

也許就從下一次對話開始,少一句「你他媽的」、多一句「謝謝你的解釋」吧?

分享給大家。

延伸閱讀:

- 原訪談:Ole Lehmann × Amanda Askell on X

- Anthropic 官方部落格:Claude's Constitution